Les paysages technologiques des entreprises évoluent à une vitesse croissante. Les décisions d’allocation des capitaux prises aujourd’hui doivent résister à la volatilité du marché, aux changements réglementaires et à l’obsolescence technologique pendant de nombreuses années. Le défi pour la direction ne réside pas dans la prédiction du prochain grand bond, mais dans la construction de systèmes suffisamment flexibles pour s’adapter lorsque ces avancées se produisent. Ce guide explore des modèles architecturaux offrant résilience et évolutivité, garantissant que les investissements technologiques génèrent de la valeur sur de longues périodes. Nous nous concentrons sur des principes structurels plutôt que sur des outils passagers, dans le but de construire une fondation capable de soutenir une croissance à long terme.

Comprendre le paysage des technologies émergentes 🌐

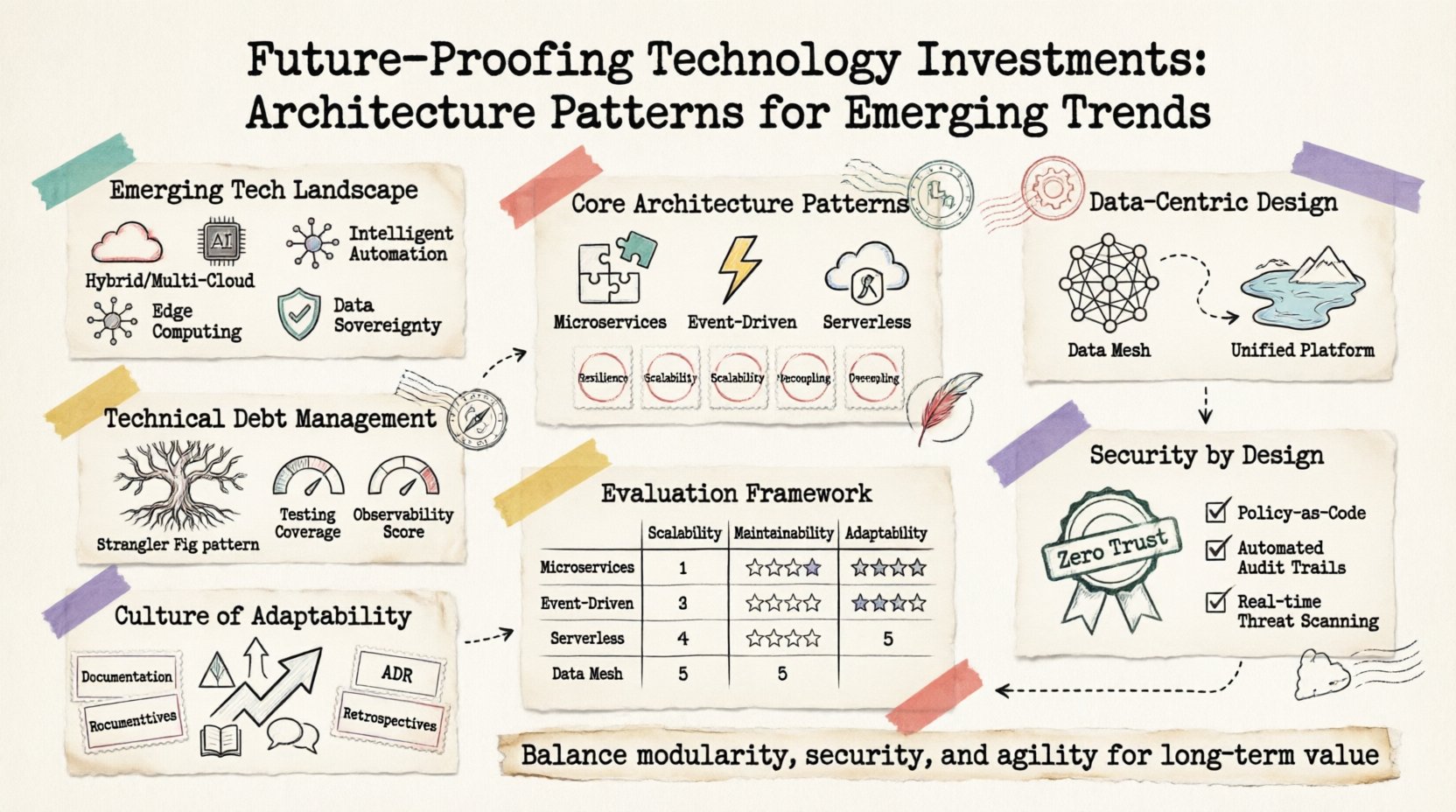

Avant de choisir un modèle, il faut comprendre les forces qui poussent au changement. L’environnement actuel est marqué par une complexité distribuée, la souveraineté des données et la nécessité de réactivité en temps réel. Les architectures monolithiques héritées peinent souvent à répondre à ces exigences sans restructurations importantes. Les tendances suivantes façonnent les exigences architecturales des entreprises modernes :

- Environnements hybrides et multi-cloud :L’infrastructure n’est plus isolée. Les applications fonctionnent simultanément sur des installations internes, des clouds privés et plusieurs fournisseurs publics.

- Automatisation intelligente :L’intelligence artificielle et l’apprentissage automatique passent des phases expérimentales aux fonctions opérationnelles essentielles.

- Calcul edge :Le traitement se déplace plus près des sources de données afin de réduire la latence et les coûts de bande passante.

- Souveraineté des données et vie privée :Les réglementations exigent un contrôle fin sur l’emplacement des données et sur la manière dont elles sont traitées.

Ignorer ces tendances expose à la création d’îlots technologiques incapables de communiquer ou de partager efficacement leurs ressources. Protéger l’avenir exige un changement de pensée, passant d’une logique centrée sur les produits à une logique centrée sur les capacités. Il faut construire des systèmes qui exposent des capacités plutôt que des fonctionnalités codées en dur.

Modèles architecturaux fondamentaux pour la résilience 🛡️

La résilience est la capacité d’un système à se rétablir après une panne tout en maintenant la continuité du service. Plusieurs modèles se sont imposés comme des standards pour atteindre cet objectif dans les environnements distribués.

1. Microservices et couplage lâche

Décomposer une grande application en services plus petits et indépendants permet aux équipes de développer, déployer et mettre à l’échelle des composants sans affecter l’ensemble de l’écosystème. Cette isolation est cruciale pour la viabilité à long terme.

- Déploiement indépendant :Un changement dans un service n’exige pas un test de régression complet de toute l’application.

- Hétérogénéité technologique :Différents services peuvent utiliser le langage ou la base de données les plus adaptés à leur fonction spécifique.

- Isolation des défaillances :Si un service échoue, le reste du système peut continuer à fonctionner, éventuellement avec une fonctionnalité dégradée.

Toutefois, cette approche introduit de la complexité. La latence du réseau, la découverte de services et la cohérence des données deviennent des préoccupations majeures. Pour atténuer ces risques, une gouvernance stricte autour des frontières des services et des contrats d’API est nécessaire.

2. Architecture orientée événements (EDA)

Dans un modèle EDA, les composants communiquent par la production et la consommation d’événements. Cela déconnecte l’expéditeur du destinataire, permettant aux systèmes de réagir aux changements d’état de manière asynchrone.

- Évolutivité :Les consommateurs peuvent évoluer indépendamment en fonction du volume d’événements reçus.

- Résilience :Si un consommateur est hors ligne, les événements peuvent être mis en file d’attente et traités une fois que le système est rétabli.

- Extensibilité :De nouveaux services peuvent être ajoutés pour écouter des événements existants sans modifier les producteurs.

Ce modèle répond au besoin de traitement de données en temps réel. Il permet au système de réagir immédiatement aux actions des utilisateurs, aux données des capteurs ou aux mises à jour transactionnelles, plutôt que d’attendre des traitements par lots.

3. Sans serveur et fonction en tant que service

Abstraire la gestion de l’infrastructure permet aux développeurs de se concentrer sur la logique. Les ressources sont allouées de manière dynamique en fonction de la demande, éliminant ainsi les coûts liés aux capacités inactives.

- Efficacité des coûts :Vous ne payez que le temps d’exécution, et non les serveurs provisionnés inactifs.

- Mise à l’échelle automatique :L’infrastructure s’ajuste automatiquement en augmentant pendant les pics et en diminuant pendant les creux.

- Réduction de la charge :Pas de correctifs, de maintenance ou de planification de capacité pour l’environnement d’exécution sous-jacent.

Le compromis inclut une latence potentielle au démarrage froid et des risques de dépendance au fournisseur. Il convient le mieux aux charges de travail sporadiques ou à des microservices spécifiques, plutôt qu’aux systèmes transactionnels persistants et à haut débit.

Stratégies de conception centrées sur les données 💾

Les données sont l’actif le plus précieux dans l’architecture d’entreprise moderne. La manière dont les données sont structurées, gouvernées et accessibles détermine la vitesse de l’innovation. Les entrepôts de données centralisés traditionnels deviennent souvent des goulets d’étranglement.

Principes du data mesh

Le data mesh considère les données comme un produit. Il décentralise la propriété des données vers les équipes de domaine qui les génèrent, plutôt que vers une équipe centrale de plateforme.

- Propriété par domaine :Les équipes sont responsables de la qualité, de l’accessibilité et de la documentation de leurs données.

- Infrastructures auto-services :Une plateforme fournit les outils aux équipes pour gérer leurs produits de données sans intervention manuelle.

- Gouvernance fédérée :Les politiques globales sont appliquées localement, garantissant la conformité sans entraver l’autonomie.

- Découplage computationnel :Les données sont stockées et traitées dans l’emplacement le plus optimal pour leur cas d’utilisation spécifique.

Cette approche réduit la charge sur les équipes informatiques centrales et accélère la disponibilité des données pour les initiatives d’analyse et d’intelligence artificielle. Elle nécessite un changement culturel vers le traitement des données comme un service avec des accords de niveau de service définis.

Plateformes unifiées de données

Alors que le mesh favorise la distribution, une plateforme unifiée garantit la découverte. Une architecture data lakehouse combine la flexibilité des lacs de données avec les fonctionnalités de gestion des entrepôts de données.

- Source unique de vérité :Les analystes et les ingénieurs accèdent à des structures de données cohérentes.

- Conformité ACID : Assure l’intégrité des données lors des transactions complexes.

- Optimisation des performances :Les stratégies d’indexation et de partitionnement sont gérées de manière centralisée pour accélérer les requêtes.

Gestion de la dette technique dans l’évolution 📉

Chaque système accumule de la dette technique au fil du temps. L’ignorer conduit à une stagnation, tandis que la refonte agressive comporte des risques d’instabilité. Une approche équilibrée est nécessaire pour maintenir la valeur de l’investissement.

Modernisation progressive

Au lieu d’une refonte « big bang », adoptez un modèle de figue étrangleur. Remplacez progressivement les fonctionnalités d’un système hérité par de nouveaux microservices. Cela permet une livraison continue tout en réduisant les risques.

- Atténuation des risques : Si le nouveau service échoue, le système hérité reste actif.

- Boucles de retour : L’utilisation réelle sur le terrain informe le développement des nouveaux composants.

- Répartition des ressources : Les équipes peuvent travailler sur la modernisation sans interrompre les opérations commerciales.

Tests automatisés et observabilité

La dette est gérable uniquement lorsqu’une visibilité existe. La journalisation complète, le traçage et la surveillance permettent aux équipes d’identifier précocement une dégradation des performances.

- Traçage bout en bout : Suivre les requêtes à travers plusieurs services pour identifier les goulets d’étranglement.

- Régression automatisée : Empêcher que le nouveau code ne perturbe les fonctionnalités existantes.

- Vérifications d’état : La vérification automatisée des composants du système assure leur disponibilité.

Sécurité et conformité par conception 🔒

La sécurité ne peut pas être une réflexion tardive. Elle doit être intégrée dans l’architecture dès la phase de conception initiale. Le modèle traditionnel de périmètre est insuffisant pour les systèmes distribués.

Architecture Zero Trust

Ne jamais faire confiance, toujours vérifier. Toute demande d’accès doit être authentifiée et autorisée, quelle que soit la localisation.

- Centrée sur l’identité : L’accès est accordé en fonction de l’identité de l’utilisateur et du contexte, et non de la localisation du réseau.

- Moins de privilèges : Les utilisateurs et les services reçoivent uniquement les autorisations minimales nécessaires.

- Micro-segmentation : Le trafic réseau est restreint à des flux spécifiques, limitant les déplacements latéraux.

Automatisation de la conformité

Les exigences réglementaires évoluent fréquemment. Les vérifications de conformité basées sur le code garantissent que l’architecture respecte automatiquement les normes.

- Infrastructure comme code : Les déploiements sont soumis au contrôle de version et auditable.

- Politique comme code : Les règles de sécurité sont appliquées par le pipeline de déploiement.

- Audit continu : La surveillance en temps réel détecte les écarts de configuration.

Cadre d’évaluation pour les investissements 📊

Comment choisissez-vous le modèle qui convient à votre organisation ? Un cadre d’évaluation structuré aide à aligner les choix technologiques sur les objectifs métiers.

| Modèle | Meilleur cas d’utilisation | Complexité | Évolutivité |

|---|---|---|---|

| Monolithique | Applications simples, petits équipes | Faible | Verticale |

| Microservices | Domaines complexes, grandes équipes | Élevée | Horizontale |

| Basé sur les événements | Données en temps réel, tâches asynchrones | Moyenne | Élevée |

| Sans serveur | Charge de travail variable, utilisation épisodique | Moyenne | Élevé |

Lors de l’évaluation des options, considérez les métriques suivantes :

- Délai de mise sur le marché : Avec quelle rapidité les nouvelles fonctionnalités peuvent-elles être livrées ?

- Coût total de possession : Inclure les coûts d’infrastructure, de maintenance et du personnel.

- Surcharge opérationnelle : Quel effort est nécessaire pour maintenir le système en fonctionnement ?

- Risque fournisseur : Quel est l’impact si un fournisseur modifie ses conditions ou ferme ses activités ?

Construire une culture d’adaptabilité 🔄

L’architecture n’est forte que dans la mesure où les personnes qui la maintiennent le sont. Investir dans la technologie suppose d’investir dans les ressources humaines. L’apprentissage continu et le partage des connaissances évitent les goulets d’étranglement où une seule personne comprend un système critique.

- Documentation :Les dossiers de décision architecturale (ADRs) capturent les raisons des choix effectués.

- Cycles de revue :Les revues régulières de l’architecture garantissent que les modèles restent alignés sur les objectifs.

- Expérimentation : Prévoir du temps pour expérimenter de nouvelles technologies dans un environnement sécurisé.

En favorisant une culture qui valorise la transparence et l’amélioration continue, les organisations peuvent naviguer les évolutions technologiques avec confiance. L’objectif n’est pas d’éliminer le changement, mais de construire des systèmes qui l’embrassent.

Réflexions finales sur l’alignement stratégique 🎯

La future-proofing est un processus continu, et non un projet ponctuel. Il exige une vigilance constante et une volonté d’évolution. En adoptant des modèles architecturaux solides, en privilégiant la gouvernance des données et en intégrant la sécurité dans la conception, les entreprises peuvent sécuriser leurs investissements technologiques à long terme. L’accent reste mis sur la création de valeur, le maintien de l’agilité et l’assurance que la technologie sert l’entreprise, et non l’inverse.

Souvenez-vous que les systèmes les plus résilients sont ceux conçus avec simplicité et modularité en tête. Évitez le surdimensionnement, mais ne compromettez pas les fondamentaux de fiabilité et de sécurité. L’équilibre est la clé de la croissance durable dans une économie numérique dynamique.