Unternehmensweite Technologielandschaften verändern sich mit zunehmender Geschwindigkeit. Die Kapitalallokationsentscheidungen, die heute getroffen werden, müssen Marktschwankungen, regulatorischen Änderungen und technologischer Veraltungsprozesse über lange Zeiträume hinweg standhalten. Die Herausforderung für die Führung liegt nicht darin, den nächsten Durchbruch vorherzusagen, sondern darin, Systeme so flexibel zu gestalten, dass sie sich anpassen können, wenn Durchbrüche eintreten. Dieser Leitfaden untersucht Architekturmuster, die Widerstandsfähigkeit und Skalierbarkeit bieten und sicherstellen, dass Technologieinvestitionen über lange Zeiträume hinweg Wert schaffen. Wir konzentrieren uns auf strukturelle Prinzipien statt auf kurzlebige Werkzeuge, um eine Grundlage zu schaffen, die langfristiges Wachstum unterstützen kann.

Verständnis der Landschaft der aufkommenden Technologien 🌐

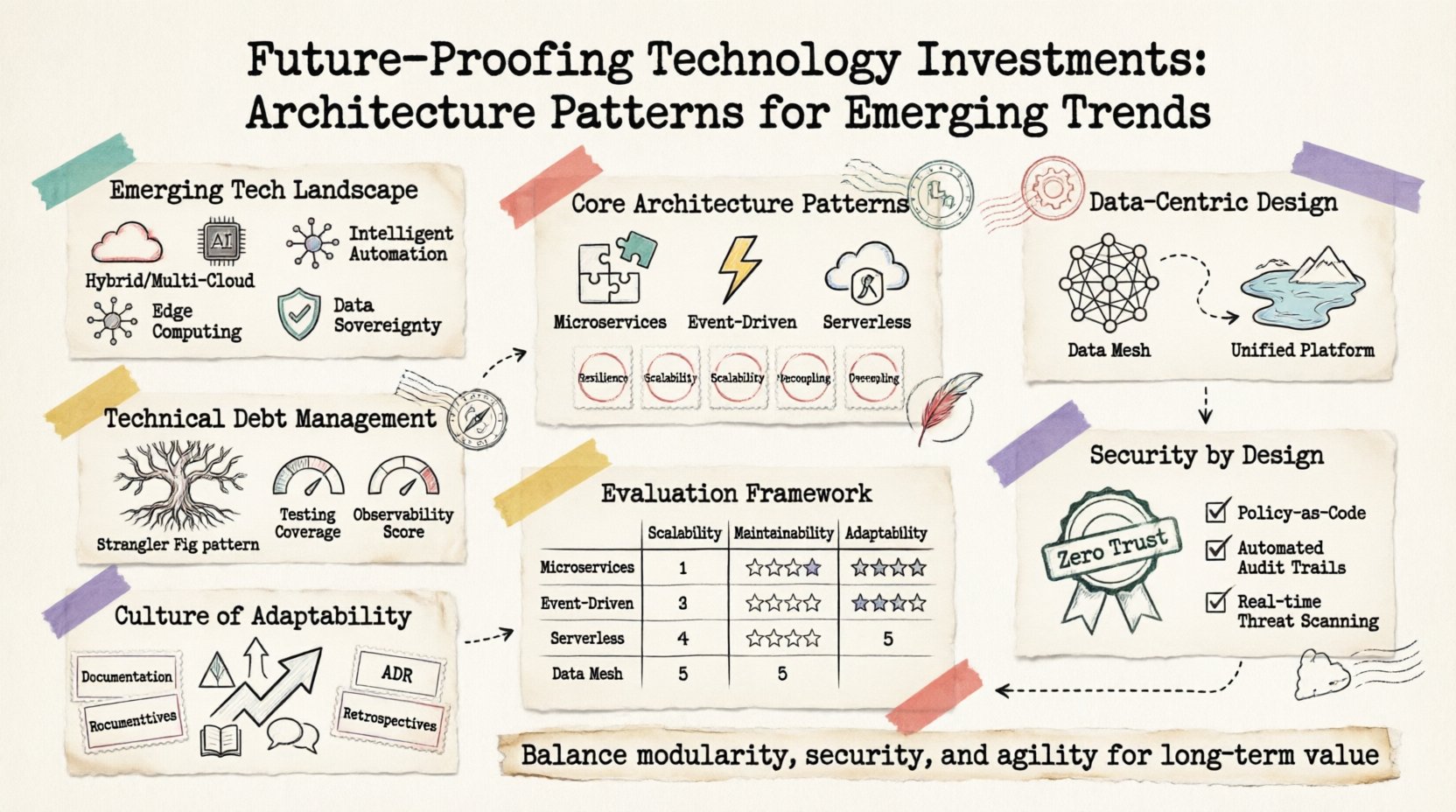

Bevor ein Muster ausgewählt wird, muss man die Kräfte verstehen, die Veränderungen antreiben. Die aktuelle Umgebung ist geprägt durch verteilte Komplexität, Datenhoheit und die Notwendigkeit von Echtzeit-Reaktionsfähigkeit. Traditionelle monolithische Strukturen kämpfen oft darum, diese Anforderungen ohne umfangreiche Umgestaltungen zu erfüllen. Die folgenden Trends prägen die architektonischen Anforderungen für moderne Unternehmen:

- Hybrid- und Multi-Cloud-Umgebungen:Die Infrastruktur ist nicht länger isoliert. Anwendungen laufen gleichzeitig in vor Ort befindlichen Einrichtungen, privaten Clouds und mehreren öffentlichen Anbietern.

- Intelligente Automatisierung:Künstliche Intelligenz und maschinelles Lernen bewegen sich von experimentellen Phasen hin zu zentralen operativen Funktionen.

- Edge Computing:Die Verarbeitung verlagert sich näher an die Datenquellen, um Latenzzeiten und Bandbreitenkosten zu reduzieren.

- Datenhoheit und Datenschutz:Vorschriften erfordern eine fein abgestimmte Kontrolle darüber, wo Daten gespeichert werden und wie sie verarbeitet werden.

Die Ignorierung dieser Trends birgt die Gefahr, technologische Inseln zu schaffen, die nicht effizient kommunizieren oder Ressourcen teilen können. Die Zukunftssicherung erfordert eine Verschiebung vom produktzentrierten Denken hin zu einem fähigkeitszentrierten Denken. Sie müssen Systeme aufbauen, die Fähigkeiten offenlegen, anstatt fest verdrahtete Funktionen zu bieten.

Grundlegende Architekturmuster für Widerstandsfähigkeit 🛡️

Widerstandsfähigkeit ist die Fähigkeit eines Systems, sich von Ausfällen zu erholen, während der Dienst weiterhin verfügbar bleibt. Mehrere Muster haben sich als Standards zur Erreichung dieser Ziele in verteilten Umgebungen etabliert.

1. Mikrodienste und lose Kopplung

Die Aufteilung einer großen Anwendung in kleinere, unabhängige Dienste ermöglicht es Teams, Komponenten zu entwickeln, bereitzustellen und zu skalieren, ohne das gesamte Ökosystem zu beeinflussen. Diese Isolation ist entscheidend für die langfristige Tragfähigkeit.

- Unabhängige Bereitstellung:Eine Änderung in einem Dienst erfordert keine vollständige Regressionstest des gesamten Anwendungsprogramms.

- Technologische Heterogenität:Verschiedene Dienste können die am besten geeignete Programmiersprache oder Datenbank für ihre spezifische Funktion nutzen.

- Ausfallisolierung:Wenn ein Dienst ausfällt, kann der Rest des Systems weiterhin arbeiten, möglicherweise mit eingeschränkter Funktionalität.

Dieser Ansatz bringt jedoch Komplexität mit sich. Netzwerklatenz, Dienstentdeckung und Datenkonsistenz werden zu bedeutenden Herausforderungen. Um diese Risiken zu minimieren, ist eine strenge Governance rund um Dienstgrenzen und API-Verträge erforderlich.

2. Ereignisgesteuerte Architektur (EDA)

In einem EDA-Modell kommunizieren Komponenten durch die Erzeugung und Verarbeitung von Ereignissen. Dadurch wird der Absender vom Empfänger entkoppelt, was es Systemen ermöglicht, asynchron auf Zustandsänderungen zu reagieren.

- Skalierbarkeit:Verbraucher können unabhängig skalieren, basierend auf der Menge an empfangenen Ereignissen.

- Widerstandsfähigkeit:Wenn ein Verbraucher offline ist, können Ereignisse in einer Warteschlange gespeichert und nach der Wiederherstellung des Systems verarbeitet werden.

- Erweiterbarkeit: Neue Dienste können hinzugefügt werden, um bestehende Ereignisse zu überwachen, ohne die Erzeuger zu ändern.

Dieses Muster unterstützt die Notwendigkeit der Echtzeitdatenverarbeitung. Es ermöglicht dem System, sofort auf Benutzeraktionen, Sensordaten oder transaktionale Aktualisierungen zu reagieren, anstatt auf Batchprozesse zu warten.

3. Serverlos und Funktion als Dienstleistung

Die Abstraktion der Infrastrukturverwaltung ermöglicht es Entwicklern, sich auf die Logik zu konzentrieren. Ressourcen werden dynamisch nach Bedarf zugewiesen, wodurch Kosten für nicht genutzte Kapazitäten entfallen.

- Kosteneffizienz: Sie zahlen nur für die Ausführungszeit, nicht für bereitgestellte Server, die untätig warten.

- Automatische Skalierung: Die Infrastruktur skaliert automatisch nach oben während Spitzenzeiten und nach unten während Tiefphasen.

- Geringerer Overhead: Kein Patchen, Wartung oder Kapazitätsplanung für die zugrundeliegende Laufzeitumgebung.

Der Kompromiss beinhaltet mögliche Latenzzeiten beim ersten Start und Risiken durch Herstellerbindung. Es eignet sich am besten für sporadische Workloads oder spezifische Mikrodienste, nicht jedoch für dauerhafte, hochdurchsatzorientierte transaktionale Systeme.

Datenzentrierte Gestaltungsstrategien 💾

Daten sind das wertvollste Gut in der modernen Unternehmensarchitektur. Wie Daten strukturiert, verwaltet und zugänglich gemacht werden, bestimmt die Geschwindigkeit der Innovation. Traditionelle zentrale Data-Warehouses werden oft zu Engpässen.

Prinzipien des Data Mesh

Data Mesh behandelt Daten als Produkt. Es dezentralisiert die Datenverantwortung an die Fachbereiche, die die Daten erzeugen, anstatt an ein zentrales Plattformteam.

- Fachbereichsverantwortung: Teams sind für die Qualität, Zugänglichkeit und Dokumentation ihrer Daten verantwortlich.

- Selbstbedienungs-Infrastruktur: Eine Plattform stellt die Werkzeuge bereit, damit Teams ihre Datenerzeugnisse ohne manuelle Eingriffe verwalten können.

- Föderierte Governance: Globale Richtlinien werden lokal durchgesetzt, was die Einhaltung von Vorschriften gewährleistet, ohne die Autonomie einzuschränken.

- Rechnerische Entkopplung: Daten werden an der am besten geeigneten Stelle für ihren spezifischen Einsatzfall gespeichert und verarbeitet.

Dieser Ansatz verringert die Belastung zentraler IT-Teams und beschleunigt die Verfügbarkeit von Daten für Analyse- und KI-Initiativen. Er erfordert eine kulturelle Veränderung hin zu einer Betrachtung von Daten als Dienstleistung mit definierten Service-Level-Vereinbarungen.

Einheitliche Datensysteme

Während das Mesh die Verteilung fördert, sorgt eine einheitliche Plattform für die Auffindbarkeit. Eine Data-Lakehouse-Architektur kombiniert die Flexibilität von Data Lakes mit den Verwaltungsfunktionen von Data-Warehouses.

- Einzelne Quelle der Wahrheit: Analysten und Ingenieure greifen auf konsistente Datenstrukturen zu.

- ACID-Konformität: Stellt die Datenintegrität während komplexer Transaktionen sicher.

- Leistungs-Optimierung:Indizierungs- und Partitionsstrategien werden zentral verwaltet, um die Abfragegeschwindigkeit zu erhöhen.

Verwaltung technischer Schulden in der Evolution 📉

Jedes System sammelt im Laufe der Zeit technische Schulden an. Die Ignorierung führt zu Stagnation, während aggressive Refaktorisierung das Risiko von Instabilität birgt. Ein ausgewogener Ansatz ist erforderlich, um den Investitionswert zu erhalten.

Schrittweise Modernisierung

Statt einer „Big-Bang“-Neuimplementierung, verwenden Sie ein Strangler-Fig-Muster. Ersetzen Sie schrittweise die Funktionalität eines veralteten Systems durch neue Mikrodienste. Dadurch ist eine kontinuierliche Bereitstellung möglich, während das Risiko reduziert wird.

- Risikominderung: Falls der neue Dienst ausfällt, bleibt das veraltete System aktiv.

- Feedback-Schleifen:Die Nutzung in der realen Welt informiert die Entwicklung der neuen Komponenten.

- Ressourcenallokation:Teams können an der Modernisierung arbeiten, ohne die Geschäftstätigkeit einzustellen.

Automatisiertes Testen und Beobachtbarkeit

Schulden sind nur dann beherrschbar, wenn Transparenz besteht. Umfassende Protokollierung, Tracing und Überwachung ermöglichen es Teams, Leistungsabfälle frühzeitig zu erkennen.

- Ende-zu-Ende-Tracing:Verfolgen Sie Anfragen über mehrere Dienste hinweg, um Engpässe zu identifizieren.

- Automatisierte Regression:Verhindern Sie, dass neuer Code bestehende Funktionalität stört.

- Gesundheitsprüfungen:Automatisierte Überprüfung der Systemkomponenten stellt die Bereitschaft sicher.

Sicherheit und Compliance von Beginn an 🔒

Sicherheit kann kein Afterthought sein. Sie muss bereits in der ersten Entwurfsphase in die Architektur integriert werden. Das traditionelle Perimeter-Modell reicht für verteilte Systeme nicht aus.

Zero-Trust-Architektur

Vertraue niemals, prüfe immer. Jeder Zugriffsversuch muss authentifiziert und autorisiert werden, unabhängig vom Standort.

- Identitätszentriert:Der Zugriff wird basierend auf der Benutzeridentität und dem Kontext gewährt, nicht auf der Netzwerkposition.

- Minimale Berechtigungen:Benutzer und Dienste erhalten nur die erforderlichen Mindestberechtigungen.

- Mikro-Segmentierung: Netzwerkverkehr ist auf bestimmte Flüsse beschränkt, was eine seitliche Bewegung einschränkt.

Compliance-Automatisierung

Regulatorische Anforderungen ändern sich häufig. Codebasierte Compliance-Prüfungen stellen sicher, dass die Architektur automatisch den Standards entspricht.

- Infrastruktur als Code: Bereitstellungen sind versionskontrolliert und nachvollziehbar.

- Richtlinien als Code: Sicherheitsregeln werden durch die Bereitstellungspipeline durchgesetzt.

- Fortlaufende Prüfung: Echtzeitüberwachung erkennt Konfigurationsabweichungen.

Evaluationsrahmen für Investitionen 📊

Wie entscheiden Sie, welcher Muster zu Ihrer Organisation passt? Ein strukturierter Evaluationsrahmen hilft dabei, technologische Entscheidungen mit den Geschäftszielen auszurichten.

| Muster | Beste Einsatzmöglichkeit | Komplexität | Skalierbarkeit |

|---|---|---|---|

| Monolithisch | Einfache Anwendungen, kleine Teams | Niedrig | Vertikal |

| Mikrodienste | Komplexe Domänen, große Teams | Hoch | Horizontal |

| Ereignisgesteuert | Echtzeitdaten, asynchrone Aufgaben | Mittel | Hoch |

| Serverlos | Variable Arbeitslasten, sporadische Nutzung | Mittel | Hoch |

Bei der Bewertung von Optionen sollten die folgenden Metriken berücksichtigt werden:

- Zeit bis zur Marktreife:Wie schnell können neue Funktionen bereitgestellt werden?

- Gesamtkosten der Nutzung:Schließen Sie Infrastruktur-, Wartungs- und Personalkosten ein.

- Betriebsaufwand:Wie groß ist der Aufwand, um das System laufend zu halten?

- Anbieter-Risiko:Welche Auswirkungen hat es, wenn ein Anbieter die Bedingungen ändert oder seine Dienste einstellt?

Aufbau einer Kultur der Anpassungsfähigkeit 🔄

Die Architektur ist nur so stark wie die Menschen, die sie pflegen. Die Investition in Technologie erfordert die Investition in das Personal. Kontinuierliches Lernen und Wissensaustausch verhindern Engpässe, bei denen nur eine Person ein kritisches System versteht.

- Dokumentation:Architektur-Entscheidungsprotokolle (ADRs) dokumentieren die Überlegungen hinter Entscheidungen.

- Überprüfungszyklen:Regelmäßige Architekturüberprüfungen stellen sicher, dass Muster weiterhin den Zielen entsprechen.

- Experimentieren:Geben Sie Zeit für die Prototypenerstellung neuer Technologien in einer sicheren Umgebung.

Durch die Förderung einer Kultur, die Transparenz und kontinuierliche Verbesserung schätzt, können Organisationen technologische Veränderungen mit Vertrauen meistern. Das Ziel ist nicht, Veränderung zu beseitigen, sondern Systeme zu schaffen, die sie annehmen.

Abschließende Gedanken zur strategischen Ausrichtung 🎯

Zukunftssicherung ist ein kontinuierlicher Prozess, kein einmaliges Projekt. Er erfordert ständige Aufmerksamkeit und die Bereitschaft zur Veränderung. Durch die Einführung robuster architektonischer Muster, die Priorisierung der Daten-Governance und die Einbindung von Sicherheit in das Design können Unternehmen ihre technologischen Investitionen langfristig sichern. Der Fokus bleibt auf der Wertschöpfung, der Aufrechterhaltung von Agilität und der Sicherstellung, dass die Technologie dem Geschäft dient, nicht umgekehrt.

Denken Sie daran, dass die widerstandsfähigsten Systeme diejenigen sind, die mit Einfachheit und Modularität im Blick entworfen wurden. Vermeiden Sie Überkonstruktion, aber verzichten Sie nicht auf die Grundlagen von Zuverlässigkeit und Sicherheit. Gleichgewicht ist entscheidend für nachhaltiges Wachstum in einer dynamischen digitalen Wirtschaft.